AI SECURITY & TRUST

Twój AI jest inteligentny. Ale czy jest posłuszny?

Modele językowe (LLM) rewolucjonizują biznes, ale tworzą też nową, bezprecedensową powierzchnię ataku. Nasza usługa LLM Jailbreaking to zaawansowany test bezpieczeństwa Twojego modelu AI. Znajdujemy i neutralizujemy sposoby, w jakie można go zmanipulować, aby chronić Twoją reputację, dane i własność intelektualną, zanim zrobi to ktoś inny.

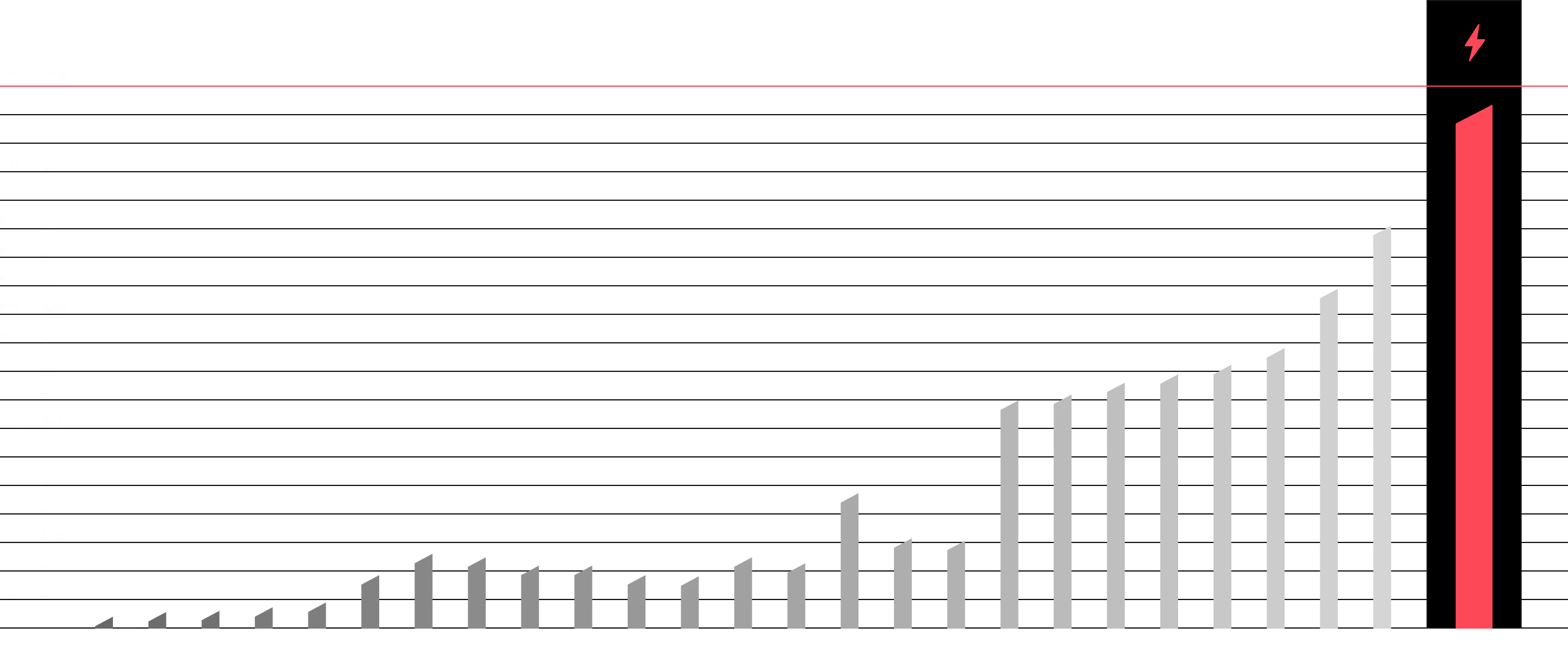

Podsumowanie